Anthropic z nowym modelem. Haiku 4.5 jest jeszcze szybszy

Jeden z głównych konkurentów dla OpenAI może pochwalić się nowym rozwiązaniem. Jest ono mniejsze, szybsze i tańsze, a przy tym równie dobre.

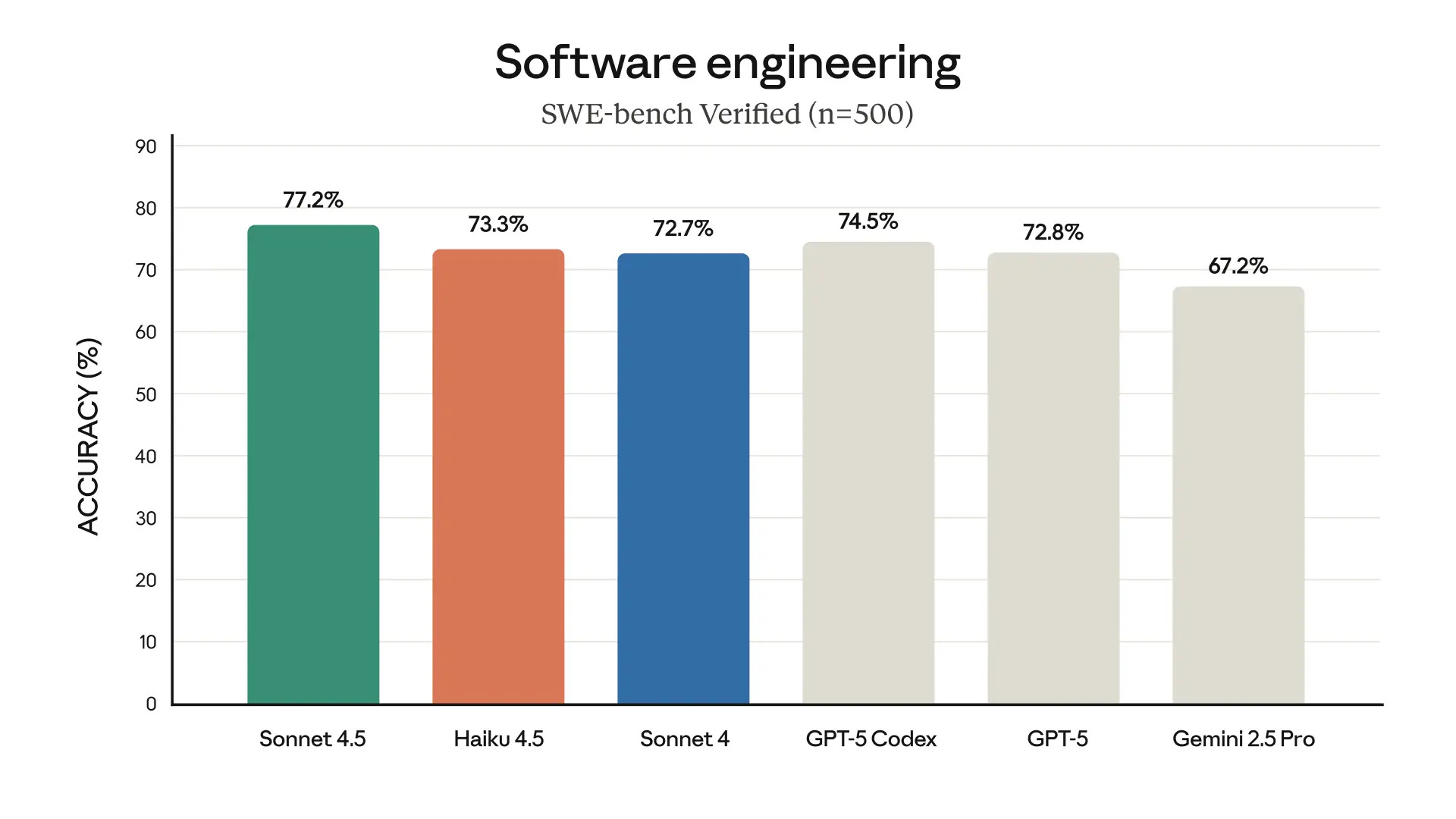

Anthropic zaprezentowało nowy model generatywnej sztucznej inteligencji Claude o nazwie Haiku 4.5. Firma poinformowała, że oferuje on taką samą zdolność do programowania jak Sonnet 4, ale jest szybszy. Model jest dostępny dla wszystkich użytkowników i stanie się domyślną wersją dla korzystających z darmowego planu na stronie Claude.ai.

Od teraz chatbot Claude odpowiada szybciej na zapytania użytkowników

Największa poprawa zdaje się występować w koszcie operacyjnym - jest on trzykrotnie niższy niż w przypadku starszego rozwiązania. Dodatkowo wtyczka Claude dla Chrome, która umożliwia korzystanie z funkcji AI bezpośrednio w przeglądarce, ma teraz działać szybciej i sprawniej w zadaniach agentowych dzięki nowemu modelowi.

Haiku 4.5 jako mniejszy model może być także wykorzystywany jako sub-agent współpracujący z Sonnet 4.5. W praktyce oznacza to, że Sonnet może planować i organizować złożone projekty, podczas gdy Haiku wykonuje poboczne zadania w tle. W przypadku kodowania Sonnet zajmuje się planowaniem i analizą, a Haiku odpowiada za refaktoryzację czy migracje.

W analizie finansowej Sonnet tworzy modele predykcyjne, a Haiku monitoruje dane, śledzi zmiany regulacyjne i sygnały rynkowe. W badaniach Sonnet może prowadzić szczegółowe analizy, podczas gdy Haiku gromadzi dane, przegląda literaturę i syntetyzuje informacje z wielu źródeł.

Wszystkie duże firmy AI idą w tym kierunku

Rosnące koszty trenowania i utrzymania dużych modeli AI sprawiają, że firmy coraz częściej opracowują mniejsze, bardziej efektywne wersje. Według raportu MIT, pojedyncze zapytanie do dużego modelu o ponad 400 miliardach parametrów może pochłonąć około 6700 dżuli energii - tyle, ile potrzeba do zasilenia kuchenki mikrofalowej przez osiem sekund. Dla porównania, mniejszy model z ośmioma miliardami parametrów zużywa jedynie 114 dżuli, a zwykłe wyszukiwanie Google około 1080 dżuli.

Stosowanie mniejszych modeli do prostszych zapytań pozwala znacząco obniżyć koszty serwerowe. Podobne podejście stosuje OpenAI w ChatGPT-5, który dynamicznie przełącza się między modelami, wykorzystując mniejsze do szybkich odpowiedzi i większe do bardziej złożonych zadań. Oszczędność energii staje się kluczowa, ponieważ firmy AI starają się zrównoważyć ogromne inwestycje w infrastrukturę centrów danych, które w najbliższych latach mogą sięgnąć bilionów dolarów.