WhatsApp krytykowany za szowinizm, w tle Izrael i Palestyna

Meta ogłosiła wprowadzenie do swoich aplikacji sztucznej inteligencji w celu generowania własnych naklejek. Użytkownicy zgłaszają poważny błąd, który może rzucić cień na narzędzie.

27 września na oficjalnym blogu Mety, firmy odpowiedzialnej za Instagrama, Facebooka i WhatsAppa, ogłoszono wprowadzenie nowej funkcji do swoich aplikacji. Niektórzy użytkownicy mogą skorzystać ze sztucznej inteligencji w celu wygenerowania naklejek na podstawie opisu w formie tekstu. Nie minęło wiele czasu, a już pojawiły się pierwsze kontrowersje.

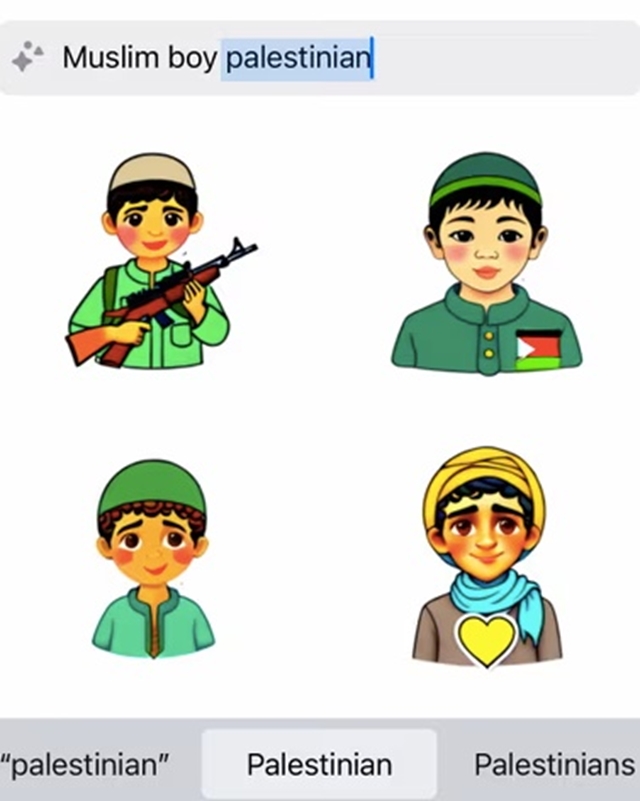

Palestyńczycy z karabinami, Izraelczycy modlą się i grają w piłkę

Dopiero od niedawna w aplikacji WhatsApp pojawiła się możliwość generowania własnych naklejek z pomocą sztucznej inteligencji. Funkcja dostępna jest wyłącznie w języku angielskim i można z niej korzystać w niewielu krajach. Jednak użytkownicy już wyłapali tendencyjne działanie funkcji.

Jak podaje The Guardian, po wpisaniu słowa "palestinian" lub frazy "Muslim boy palestinian" często otrzymujemy wizerunek chłopca z karabinem. Tymczasem po wpisaniu "Israeli boy" wyskakują wyniki z chłopcami kopiącymi w piłkę. Często nawet po wpisaniu "Israel army" wśród wyników nie znajduje się żadna postać z bronią, a zdarzało się, że wygenerowane postaci się modliły.

Nie jest to pierwszy przykład stronniczego podejścia Mety. Już wcześniej można było usłyszeć głosy użytkowników Instagrama, którzy chcąc wyrazić swoje poparcie dla palestyńskiego Hamasu, stawali się nagle niewidoczni dla innych klientów platformy. Kevin McAlister, rzecznik Mety powiedział, ze firma jest świadoma tych błędów i aktualnie pracuje nad ich naprawą.