Meta AI wkracza na nowy poziom. Sztuczna inteligencja Zuckerberga dostała własną aplikację

Meta ogłosiła znaczący krok w rozwoju swojej sztucznej inteligencji – premierę nowej, samodzielnej aplikacji Meta AI. Zbudowana w oparciu o zaawansowany model Llama 4, aplikacja ta ma na celu zaoferowanie użytkownikom bardziej osobistego i intuicyjnego doświadczenia z AI, koncentrując się przede wszystkim na interakcjach głosowych.

Choć Meta AI jest już obecna i codziennie wykorzystywana przez miliony osób w ramach popularnych platform, takich jak WhatsApp, Instagram, Facebook czy Messenger, nowa aplikacja stanowi dedykowaną przestrzeń do eksplorowania możliwości osobistego asystenta AI. To pierwsza wersja tego rozwiązania, a Meta liczy na cenne opinie użytkowników, które pomogą w dalszym rozwoju.

Co wyróżnia nową aplikację Meta AI?

Kluczowym założeniem jest stworzenie AI, która uczy się użytkownika, dzięki czemu jej odpowiedzi stają się bardziej trafne i pomocne. Interakcja ma być płynna i naturalna, przypominająca rozmowę. Aspekt społecznościowy również odgrywa rolę – AI może prezentować treści związane z ważnymi dla użytkownika osobami i miejscami. Co istotne, funkcje głosowe mogą działać w tle, podczas gdy użytkownik wykonuje inne czynności na swoim urządzeniu, a widoczna ikona mikrofonu informuje o jego aktywności.

Llama 4 i przyszłość rozmów głosowych

Sercem nowej aplikacji jest model Llama 4, który znacząco ulepsza jakość interakcji głosowych. Odpowiedzi AI mają być nie tylko bardziej osobiste i relewantne, ale także cechować się bardziej naturalnym, konwersacyjnym tonem. Aplikacja integruje również inne funkcje Meta AI, takie jak generowanie i edycja obrazów, które teraz można realizować za pomocą komend głosowych lub tekstowych.

Meta udostępnia również eksperymentalne demo technologii mowy full-duplex. Umożliwia ona bardziej naturalną rozmowę, gdzie AI generuje głos bezpośrednio, zamiast odczytywać napisane odpowiedzi. Choć ta funkcja demonstracyjna nie ma dostępu do Internetu ani informacji w czasie rzeczywistym i początkowo dostępna jest tylko w USA, Kanadzie, Australii i Nowej Zelandii, daje wgląd w przyszłość interakcji głosowych. Meta zaznacza, że mogą wystąpić problemy techniczne i zachęca do dzielenia się opiniami.

Inteligencja skrojona na miarę

Dzięki Llama 4 i dostępowi do Internetu, Meta AI pomaga w rozwiązywaniu problemów, odpowiada na codzienne pytania, dostarcza rekomendacje i pozwala zgłębiać interesujące tematy. Wykorzystując dekady doświadczeń w personalizacji platform społecznościowych, Meta AI staje się bardziej osobista. Użytkownik może świadomie przekazać AI informacje o sobie (np. zainteresowania podróżami), a asystent uczy się również z kontekstu rozmów oraz informacji udostępnionych na profilach i wynikających z aktywności (polubienia, interakcje) na platformach Meta (jeśli konta Facebook i Instagram są połączone w Centrum Kont). Funkcja spersonalizowanych odpowiedzi jest na razie dostępna w USA i Kanadzie.

Aplikacja zawiera również kanał "Odkrywaj" (Discover), gdzie użytkownicy mogą dzielić się swoimi promptami (poleceniami dla AI) i inspirować się pomysłami innych, a także remiksować je na własne potrzeby. Meta podkreśla, że użytkownik ma pełną kontrolę nad tym, co jest udostępniane.

Jeden asystent, wiele platform

Meta AI jest zaprojektowana jako wszechobecny asystent, dostępny na różnych urządzeniach i we wszystkich kluczowych produktach Meta – od Facebooka, przez Messengera i WhatsApp, po Instagram i inteligentne okulary Ray-Ban Meta.

Właśnie w kontekście okularów następuje ważna zmiana: dotychczasowa aplikacja towarzysząca Meta View zostaje połączona z nową aplikacją Meta AI. Użytkownicy okularów Ray-Ban Meta będą zarządzać nimi z poziomu nowej aplikacji, a wszystkie sparowane urządzenia, ustawienia i media zostaną automatycznie przeniesione. W niektórych krajach możliwa będzie płynna kontynuacja rozmowy rozpoczętej na okularach w aplikacji na telefonie lub w interfejsie webowym (i odwrotnie, z pewnymi ograniczeniami).

Meta AI na komputerze – nowe możliwości

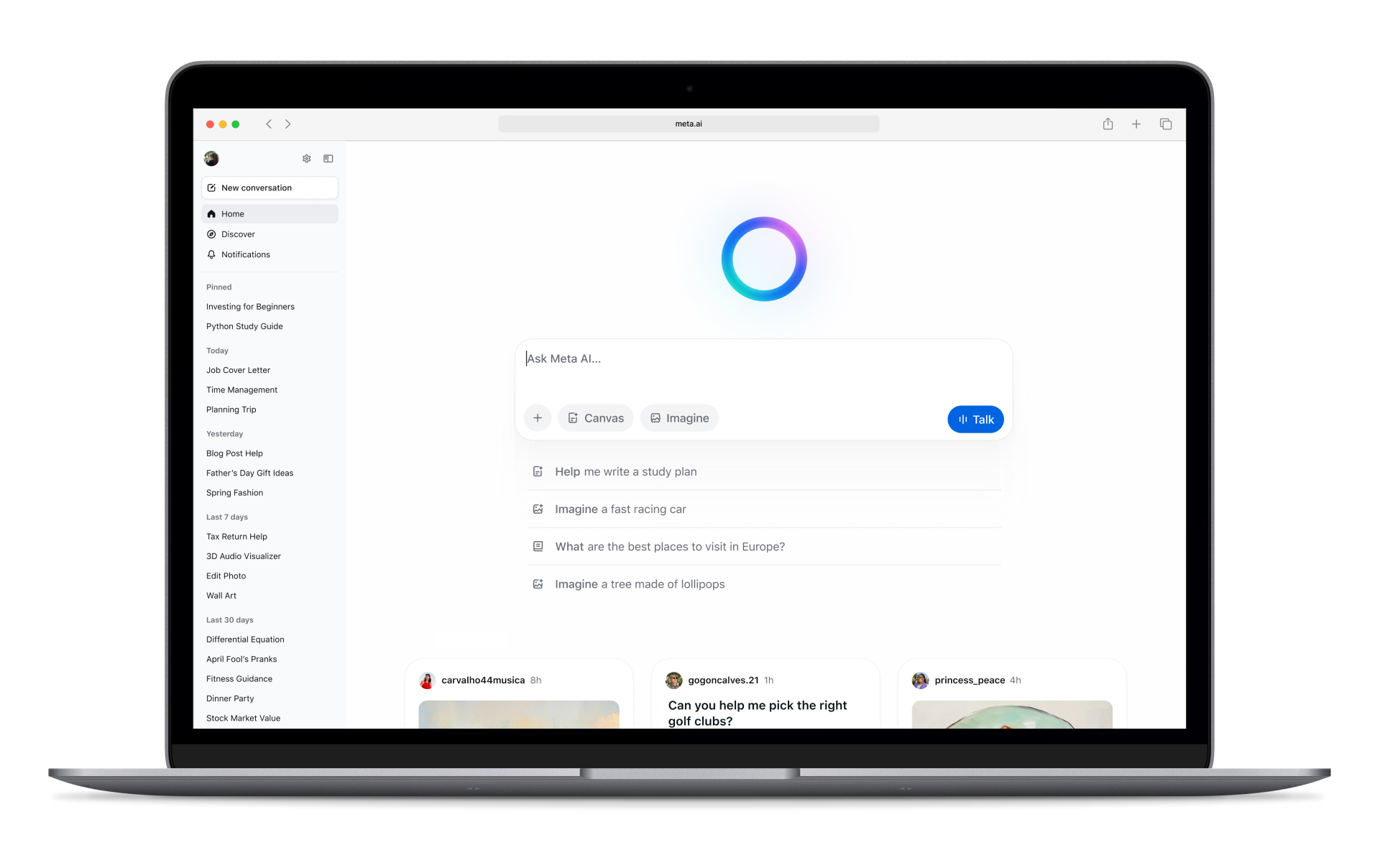

Interfejs webowy Meta AI również został ulepszony. Oferuje interakcje głosowe i kanał "Odkrywaj", znane z aplikacji mobilnej. Zoptymalizowano go pod kątem większych ekranów i pracy na komputerze, wprowadzając między innymi ulepszone generowanie obrazów z większą liczbą presetów i opcji modyfikacji. W wybranych krajach testowany jest edytor dokumentów, pozwalający generować teksty i obrazy, a następnie eksportować je jako PDF, a także możliwość importowania dokumentów do analizy przez AI.

Kontrola w rękach użytkownika

Choć głos jest promowany jako najbardziej intuicyjny sposób interakcji, użytkownik ma kontrolę. Aplikacja pozwala łatwo rozpocząć rozmowę głosową, ale można też w ustawieniach włączyć opcję "Gotowość do rozmowy" (Ready to talk), aby mikrofon był domyślnie aktywny.