Oto lekarz przyszłości. Opoka hipochondryków, koszmar paranoików

Martwisz się o swoje zdrowie? Chcesz przeanalizować wyniki badań? Przychodnia już zamknięta? Nie ma problemu, na pomoc przychodzi AI.

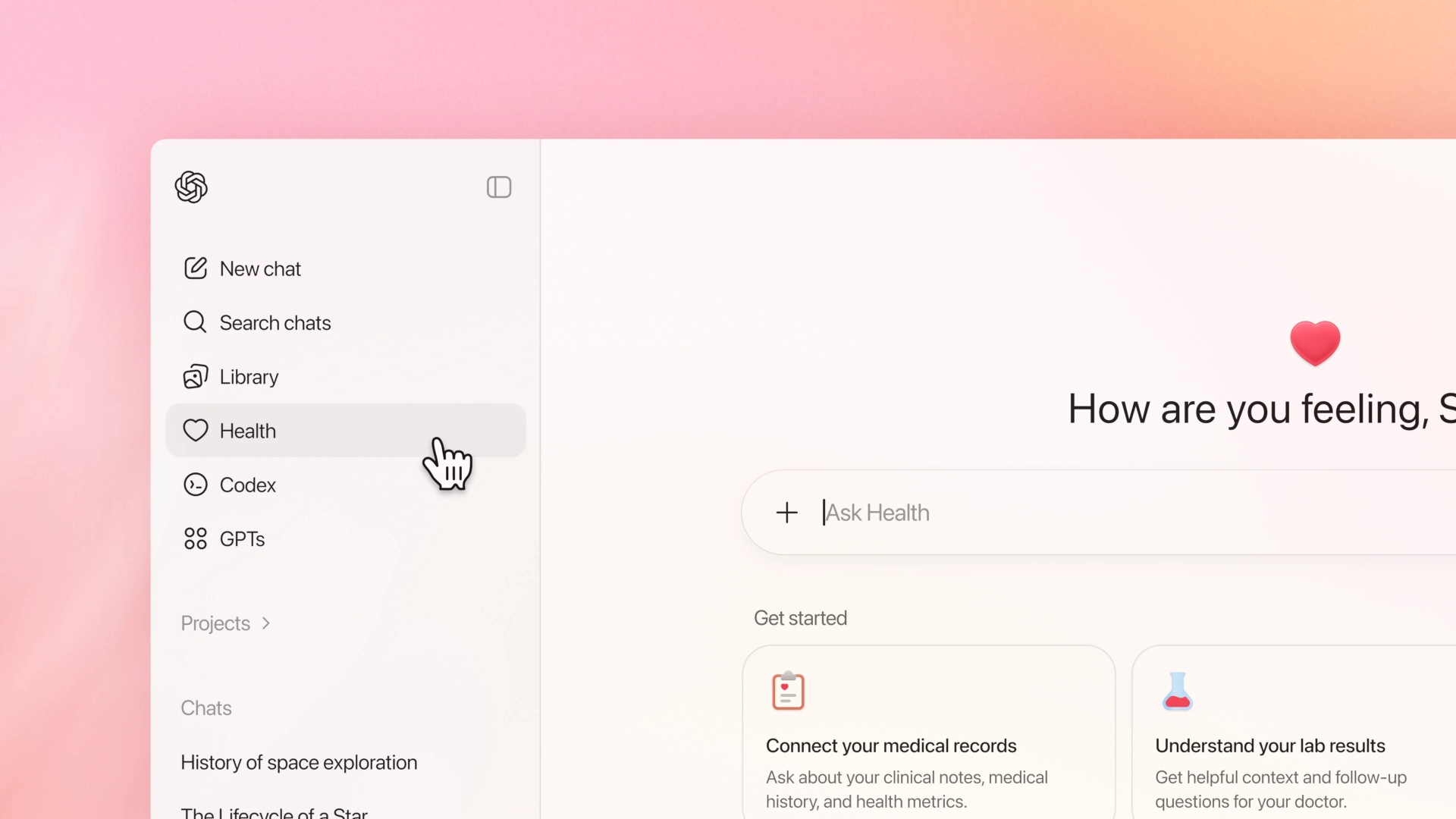

OpenAI coraz wyraźniej sygnalizuje, że widzi sztuczną inteligencję jako wsparcie dla zdrowia. Teraz te zapowiedzi materializują się w postaci nowego rozwiązania - ChatGPT Health, czyli specjalnej przestrzeni w obrębie ChatGPT, przeznaczonej wyłącznie do rozmów o zdrowiu i samopoczuciu.

Na start tylko dla wybranych, w formie beta testów

Nowa funkcja ma działać jak odizolowana strefa, z osobną historią czatów i pamięcią, oddzieloną od reszty konwersacji prowadzonych z chatbotem. Według deklaracji OpenAI ma to zapewnić wyższy poziom prywatności i bezpieczeństwa przy omawianiu wrażliwych tematów. Użytkownicy będą mogli dodatkowo podłączyć swoje dane zdrowotne oraz aplikacje wellness, aby uzyskać bardziej dopasowane odpowiedzi.

Wśród wspieranych integracji wymieniane są m.in. Apple Health, Peloton, MyFitnessPal, Weight Watchers czy Function. Dane z tych źródeł mają pozwolić na analizę wyników badań laboratoryjnych, historii wizyt lekarskich, nawyków żywieniowych, snu, aktywności fizycznej oraz ogólnego stylu życia. W USA nawiązano też współpracę z firmą b.well.

Na start ChatGPT Health trafia do ograniczonej grupy użytkowników w ramach beta testów. Dostęp wymaga zapisania się na listę oczekujących, ale OpenAI zapowiada stopniowe udostępnianie funkcji wszystkim, niezależnie od posiadanego abonamentu.

OpenAI zapewnia, że nowe narzędzie było konsultowane z lekarzami

Firma wyraźnie podkreśla, że ChatGPT Health nie jest narzędziem do diagnozowania ani leczenia. Jednocześnie sama przyznaje, że już dziś z chatbota korzysta się masowo w kontekście zdrowia. Według danych OpenAI ponad 230 milionów osób na świecie co tydzień zadaje ChatGPT pytania związane ze zdrowiem, a znacząca część takich rozmów odbywa się poza standardowymi godzinami pracy przychodni.

W tle pojawiają się jednak kontrowersje. Historia zna już przypadki, gdy porady generowane przez AI prowadziły do realnych zagrożeń zdrowotnych. Głośno było zarówno o błędnych zaleceniach dietetycznych, jak i o problemach z dezinformacją medyczną ze strony np. Google Gemini. OpenAI zapewnia, że nowe narzędzie było konsultowane z lekarzami, a w ciągu ostatnich dwóch lat ponad 260 specjalistów przekazało setki tysięcy opinii, które miały pomóc w dopracowaniu odpowiedzi modelu.

Dane będą chronione, ale nie przed wszystkimi

Pod względem bezpieczeństwa danych OpenAI deklaruje zastosowanie wielowarstwowego szyfrowania i oddzielenie rozmów zdrowotnych od procesu trenowania modeli. Jeśli użytkownik zacznie rozmowę o zdrowiu w standardowym czacie, system ma sugerować przeniesienie jej do sekcji Health. Firma nie ukrywa jednak, że w określonych sytuacjach, takich jak nakaz sądowy czy stan wyższej konieczności, może być zobowiązana do udostępnienia danych odpowiednim instytucjom.