NVIDIA pośpiesza SK hynix. W tle są miliardy dolarów

Szaleństwo na sztuczną inteligencję trwa w najlepsze. NVIDIA ma sporo wolnych pieniędzy na rozwój jeszcze wydajniejszych akceleratorów AI i chętnie je wydaje.

SK hynix podobno znacznie przyśpieszyło prace nad technologią HBM4, czyli wydajnymi pamięciami dla akceleratorów AI. Koreańska firma planuje rozpocząć wysyłkę próbek testowych do NVIDII już w czerwcu tego roku, co jest wcześniejszym terminem niż pierwotnie zakładano. Zaś dostawy gotowych kości przewidywane są na końcówkę trzeciego kwartału 2025.

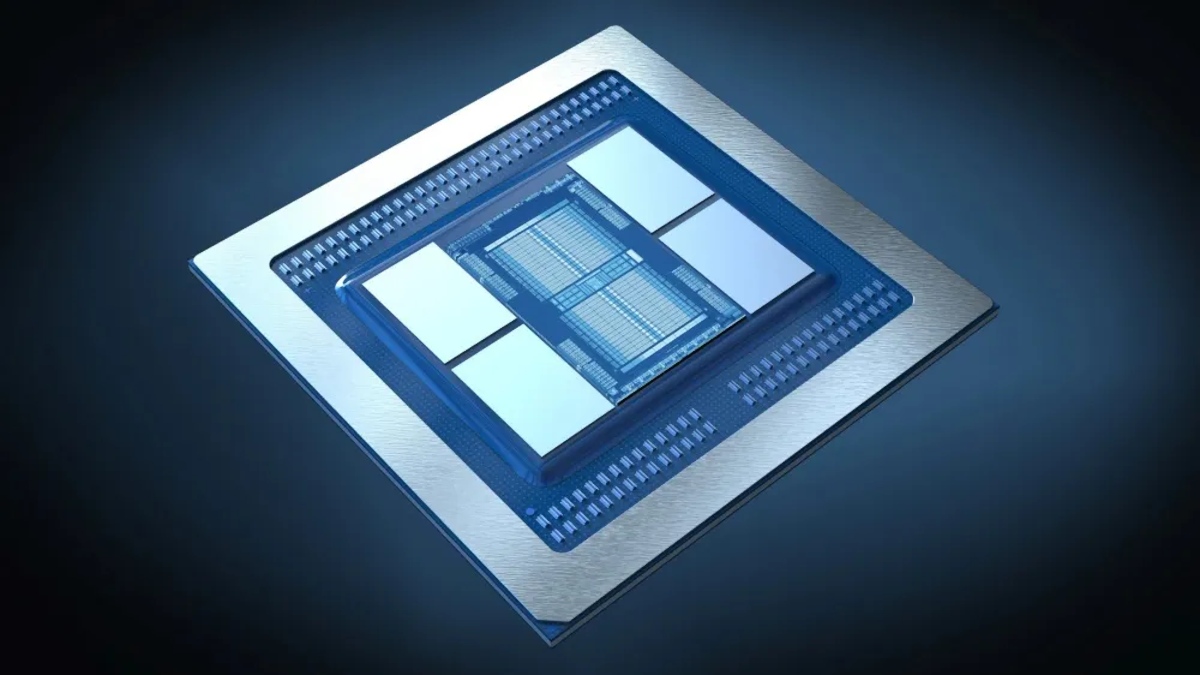

Rodzina NVIDIA Rubin jako pierwsza wykorzysta HBM4

HBM4 to szósta generacja pamięci o wysokiej przepustowości (High-Bandwidth Memory) wykorzystującej architekturę DRAM. Jest następcą HBM3E, które obecnie znajduje się już w masowej produkcji. Według składanych obietnic nowe rozwiązanie zaoferuje znaczący skok wydajności, podwajając możliwości transferu danych dzięki 2048 kanałom I/O, co stanowi ogromny postęp względem poprzedniej wersji.

Według aktualnych informacji HBM4 trafi jako pierwsze do rodziny NVIDIA Rubin, czyli potężnych akceleratorów AI planowanych pierwotnie na 2026 rok. Jednak Zieloni zmienili podobno plany, a debiut ma nastąpić pod koniec 2025 roku - stąd pośpieszanie SK hynix. I chociaż stanowi to wyzwanie dla Koreańczyków, to nikt nie chce zawieść Amerykanów. Zwłaszcza, gdy w tle jest współpraca opiewająca na miliardy dolarów.