Chociaż firm zajmujących się na poważnie sztuczną inteligencją jest już więcej niż kilka, to wszystkie z nich korzystają z tych samych układów. Zarówno giganci tacy jak OpenAI, Meta czy Microsoft wybierają przede wszystkim układy od NVIDII. Powód? Znacznie wyższa wydajność niż u AMD czy Intela.

Modele takie jak NVIDIA H100 czy H200 zasilają najpotężniejsze superkomputery i serwerownie na świecie. Zieloni jednak mają już następce generacji Hopper. Jensen Huang zaprezentował dzisiaj oficjalnie procesor graficznych NVIDIA Blackwell B200 stworzony od podstaw z myślą o sztucznej inteligencji.

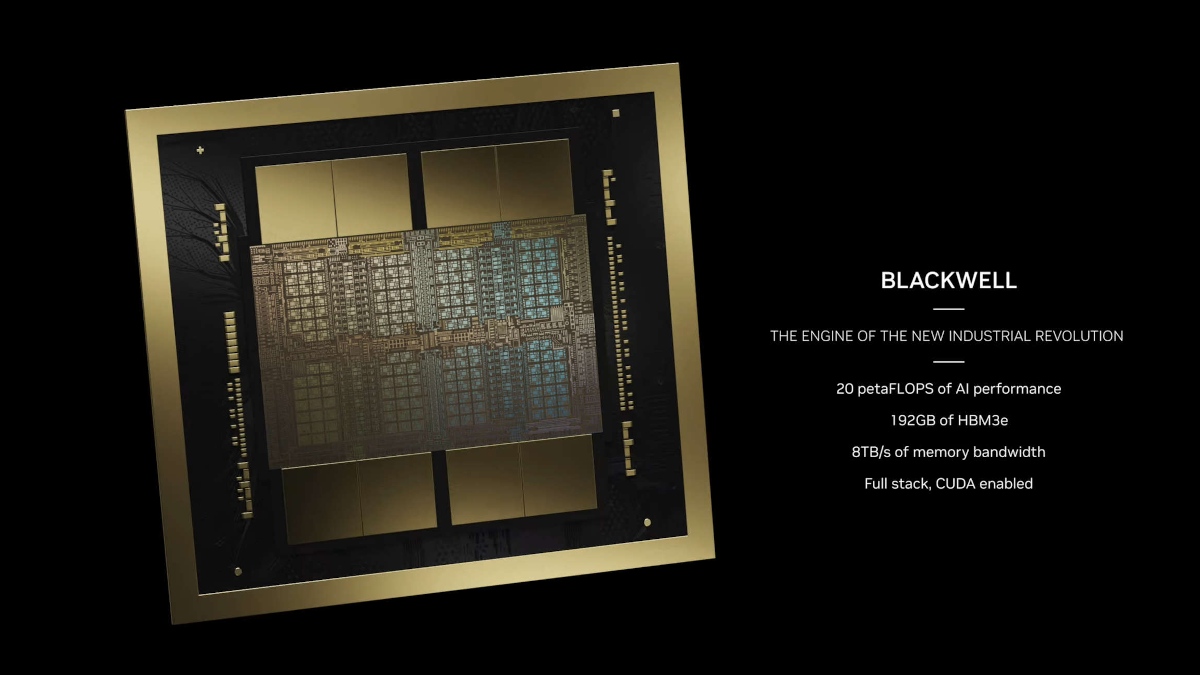

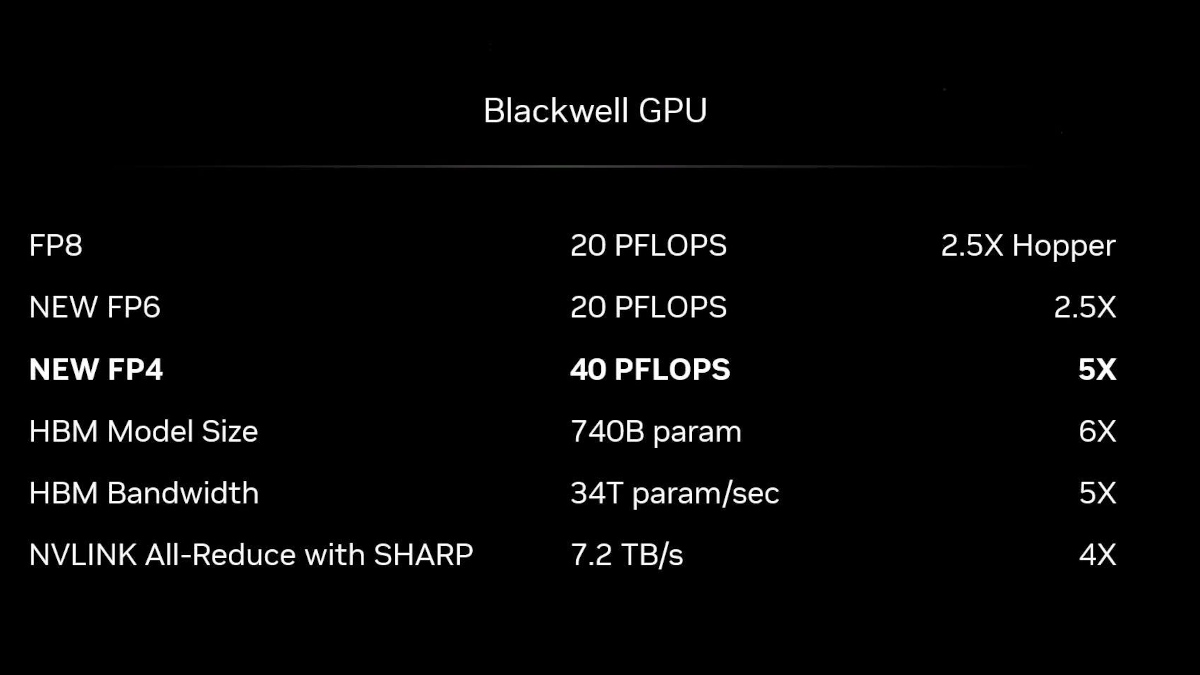

NVIDIA B200 oferuje względem H100 ponad dwukrotnie zwiększa liczbę tranzystorów - skok z 80 do 208 miliardów. Dodatkowo mowa o wydajności 20 PFLOPS w zadaniach AI, podczas gdy H100 to "ledwie" 4 PFLOPS. Wisienką na torcie jest pojemniejsza i szybsza pamięć VRAM - 192 GB HBM3e o przepustowości do 8 TB/s.

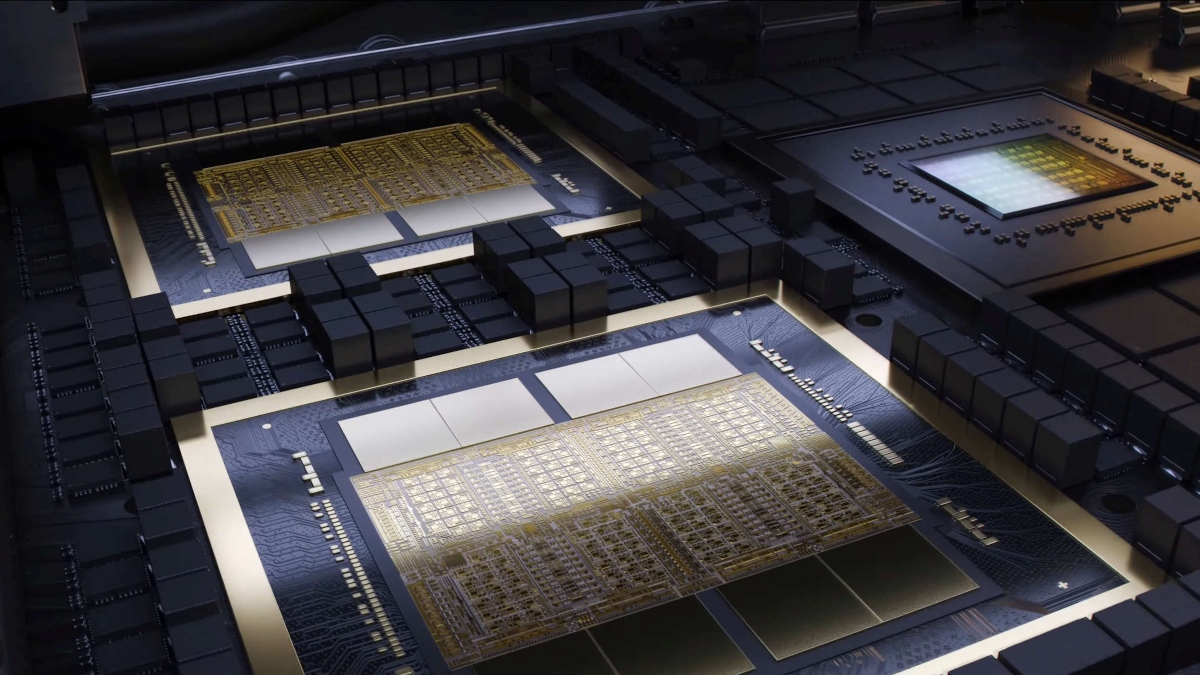

Warto jednak podkreślić, że NVIDIA B200 nie korzysta z budowy monolitycznej. Zamiast tego mamy połączenie dwóch rdzeni, które działają jako jeden zunifikowany procesor graficzny CUDA. Są one połączone z pomocą interfejsu NV-HBI (Nvidia High Bandwidth Interface) o przepustowości 10 TB/s.

Litografia to TSMC 4NP, a więc udoskonalona wersja dotychczasowego 4N używanego przez układy Hopper i Ada Lovelace. To też zapewne powód takiej konstrukcji - należy zakładać niewielką poprawę gęstości, co wymusiło połączenie ze sobą dwóch rdzeni ze względu na wykorzystanie już pełnego rozmiaru siatki.

NVIDIA szykuje dla swoich klientów przynajmniej pięć różnych układów - GB200, B200, B100, HGX B200 oraz HGX B100. Pierwszy z wymienionych to superukład o poborze mocy do 2700 W, który wyposażono w dwa opisane wcześniej rdzenie B200 oraz dodatkowo jeden z rodziny Grace.

Zobacz: AOC ma hiciora. Tak wygląda świetny OLED dla graczy

Zobacz: Elon Musk się naćpał i przekonuje, że ludzie powinni się cieszyć

Źródło zdjęć: NVIDIA

Źródło tekstu: NVIDIA, oprac. własne